Правило открытого кода.

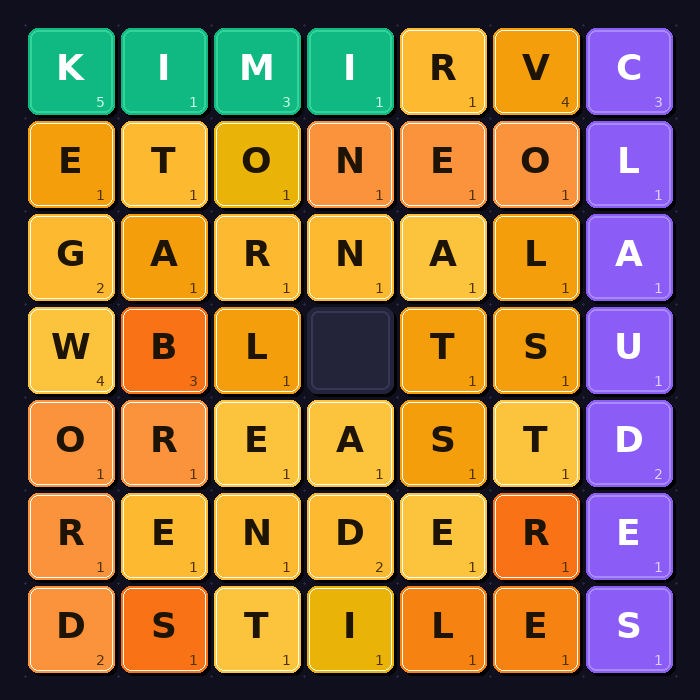

Вот такой сейсмический, и, честно говоря, весьма волнующий вывод из последнего AI Coding Contest, а именно из 12-го дня соревнования — Word Gem Puzzle. Рохана Резел, организатор текущего испытания, где большие языковые модели соревнуются в решении реальных задач по программированию, опубликовал результаты, и они стали ощутимым ударом для привычных фаворитов. Kimi K2.6, модель с открытым исходным кодом от китайского стартапа Moonshot AI, не просто участвовала; она доминировала, одержав чистую победу с 22 очками и рекордом 7-1-0. Для контекста: это означает, что она обошла всё остальное, включая то, что предположительно являются моделями высшего эшелона от западных ИИ-лабораторий.

Самый обидный проигрыш: Западные лаборатории отстают

Рейтинг ИИ-моделей давно является предметом бурных спекуляций и напряжённого корпоративного позиционирования. Серии GPT от OpenAI, Claude от Anthropic и Gemini от Google были бесспорными тяжеловесами, их предполагаемое превосходство часто принималось как данность. Однако в этом тщательно структурированном соревновании по программированию результаты оказались разительно иными. MiMo V2-Pro от Xiaomi заняла второе место, за ней последовала GPT-5.5 на третьем, а Claude Opus 4.7 с трудом финишировала пятой. Каждая модель от предполагаемых западных “передовых лабораторий” — титанов разработки ИИ — оказалась ниже первых двух позиций. Это не тонкий сдвиг; это полная перестройка нарратива.

Как работает головоломка и почему это важно

Сама по себе Word Gem Puzzle — это увлекательный испытательный стенд. Это головоломка с перемещением плиток с буквами и изюминкой: игроки (или боты) манипулируют сеткой, сдвигая плитки в пустое пространство, чтобы сформировать допустимые английские слова по горизонтали или вертикали. Подсчёт очков имеет решающее значение: он сильно штрафует за короткие слова (трёхбуквенное слово стоит три очка, пятибуквенное — одно), в то время как вознаграждает более длинные (семь букв и более приносят очки, равные их длине минус шесть). Это стимулирует сложное формирование слов и стратегическую манипуляцию полем, а не просто грубую силу распознавания образов. Это задача, требующая не только понимания языка, но и планирования, предвидения и адаптивной стратегии — качеств, которые мы часто ассоциируем с утончённым интеллектом.

Сетки, заполненные реальными словами, а затем плитки с буквами на основе частоты в Scrabble, перемешиваются агрессивнее на больших досках. Это означает, что на маленьких сетках (10x10) многие исходные слова могут сохраниться. Но на сетке 30x30 исходная структура в значительной степени уничтожается, вынуждая модели конструировать слова с нуля, что является гораздо более сложной задачей. Это процедурное различие — ключ к пониманию успеха Kimi.

Агрессивная стратегия Kimi принесла плоды

Что же сделала Kimi K2.6, чего не сделали другие? Журналы действий, сырые данные соревнования, рассказывают убедительную историю. Kimi использовала агрессивную, жадную стратегию: она постоянно оценивала каждый возможный сдвиг на основе новых слов с положительной стоимостью, которые она могла открыть. Если такого хода не существовало, она возвращалась к ходу по умолчанию. Этот подход, хотя и приводил к некоторой неэффективной “пограничной осцилляции” (безрезультатное перемещение пустого поля взад-вперёд) на меньших досках, оказался разрушительно эффективным на больших, более перемешанных сетках. Здесь, где реконструкция слов была единственным путём к очкам, огромный объём эффективных сдвигов Kimi, приведший к совокупному счёту 77, стал решающим фактором.

В отличие от этого, MiMo V2-Pro, несмотря на второе место, имела удивительно хрупкую стратегию. Её код, хоть и присутствовал, никогда не инициировал сдвиг, поскольку её порог “лучшей стоимости больше нуля” никогда не активировался. По сути, она сканировала исходную сетку на предмет существующих слов из семи и более букв и одновременно заявляла все свои права. Это прекрасно работало на сетках, где перемешивание оставляло нетронутыми исходные слова, но не давало ничего там, где их не было. Это стратегия, полностью зависящая от удачи начального состояния поля, а не от адаптивной игры.

Стагнация гигантов

А что же признанные игроки? Claude Opus 4.7, согласно журналам, также не совершала сдвигов. Её производительность держалась на досках 25x25, где перемешивание было управляемым, но она “рассыпалась на 30x30, где требовалось фактическое движение плиток”. Это фундаментальное ограничение в головоломке, явно построенной на принципе перемещения. GPT-5.5 была более консервативной, демонстрируя силу на досках 15x15 и 30x30, но её общий подход кажется менее динамичным, чем выигрышная формула Kimi.

Это суровое напоминание о том, что инновации — это не только прерогатива существующих игроков с самыми глубокими карманами и наибольшими объёмами данных. Тот факт, что модель с открытым исходным кодом, доступная любому, кто хочет её изучить и развивать, может превзойти закрытые проприетарные системы в конкретной, чётко определённой задаче, имеет огромное значение. Это намекает на архитектурную эффективность, новые методологии обучения или, возможно, более сфокусированный подход к решению проблем, который более крупные лаборатории могут упускать в своём стремлении к общему интеллекту.

Мой уникальный взгляд на это? Общепринятое мнение о том, что “больше — всегда лучше” в ИИ, активно оспаривается не только благодаря умной инженерии, но и благодаря возобновлённому фокусу на оптимизации под конкретную задачу и, что критически важно, доступности. Модели с открытым исходным кодом, разработанные с чёткой целью и сильной оценкой, действительно могут обойти своих более монолитных конкурентов. Речь идёт не просто об одном соревновании; это сигнал о будущем разработки ИИ: потенциальная демократизация, подпитываемая доступными, высокопроизводительными фундаментальными моделями.

Почему это важно для разработчиков?

Это не просто академический курьёз. Для разработчиков появление таких моделей, как Kimi K2.6, означает появление более мощных, потенциально более экономически эффективных инструментов. Тот факт, что Kimi имеет открытый исходный код, является настоящим прорывом. Он приглашает к проверке, модификации и интеграции способами, которые закрытые API просто не могут обеспечить. Представьте себе дообучение модели, которая уже доказала свою состоятельность в сложных задачах кодирования, адаптируя её под ваши конкретные нужды разработки приложений без ограничений проприетарного доступа. Это снижает порог входа для разработки с использованием передовых ИИ, способствуя более распределённой и инновационной экосистеме. Последствия для специализированных ИИ-агентов, инструментов генерации кода и даже фундаментального способа взаимодействия с средами разработки весьма значительны.

FAQ

Что такое Kimi K2.6? Kimi K2.6 — это языковая модель с открытым исходным кодом, разработанная Moonshot AI, китайским стартапом. Недавно она превзошла модели вроде Claude Opus и GPT-5.5 на соревновании по ИИ-кодингу.

Почему производительность Kimi K2.6 значима? Её производительность значима, потому что это модель с открытым исходным кодом, которая превзошла признанные проприетарные модели от ведущих западных ИИ-лабораторий в сложной задаче кодирования, что предполагает сдвиг в разработке и доступности ИИ.

Заменит ли эта модель с открытым исходным кодом мою работу? Хотя инструменты ИИ могут автоматизировать определённые задачи, они, скорее всего, дополнят роли разработчиков, беря на себя рутинное кодирование, отладку и решение сложных проблем, позволяя людям сосредоточиться на высокоуровневом дизайне, архитектуре и творчестве. Рост мощных моделей с открытым исходным кодом может демократизировать доступ к передовым возможностям ИИ для разработчиков.