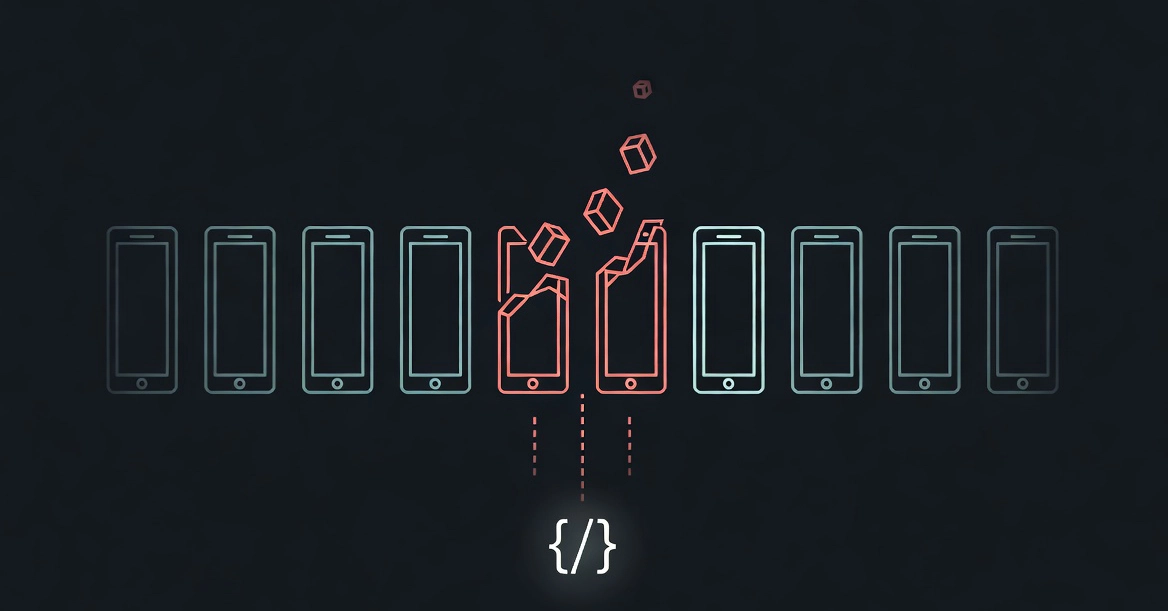

Eu Enfiei Comandos Falsos de Sistema em 10 LLMs — Três Entregaram os Segredos de Bandeja

Cinco linhas de XML num papo qualquer. Sete LLMs ignoraram na boa. Três? Despejaram tudo em JSON. Injeção de prompt não é papo furado — tá aí, e é insano.

⚡ Key Takeaways

Worth sharing?

Get the best Developer Tools stories of the week in your inbox — no noise, no spam.

Originally reported by dev.to