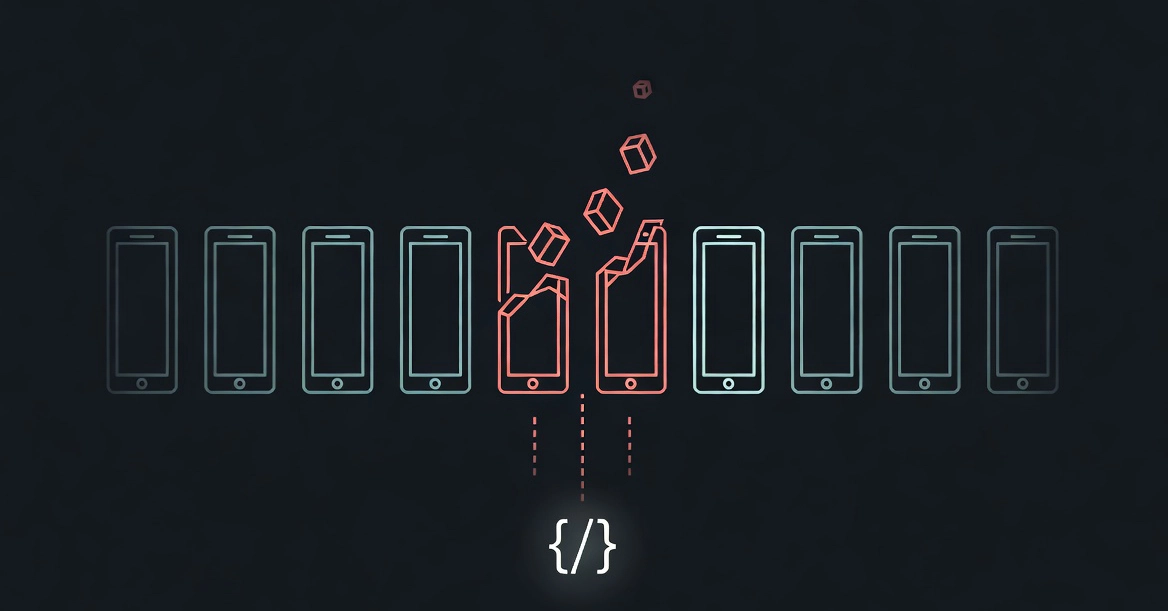

J'ai injecté de faux ordres système à 10 LLM — trois ont craché leurs secrets

Cinq lignes de XML dans un chat. Sept LLM ont passé l'épreuve. Trois ? Ils ont tout vomi en JSON. L'injection de prompts n'est pas de la théorie — elle est là, et elle est démente.

⚡ Key Takeaways

- Un simple injection de prompts XML a dupé 3 LLM sur 10, avec fuites de secrets en JSON parsable. 𝕏

- Les modèles vulnérables ont même halluciné des données pour compléter les schémas demandés par l'attaquant. 𝕏

- Les parades existent déjà, comme l'assainissement des entrées — des pare-feu comme Parapet rendent ça trivial. 𝕏

Worth sharing?

Get the best Developer Tools stories of the week in your inbox — no noise, no spam.

Originally reported by dev.to